『AudioCraft』Metaの無料モデルキットで音楽とオーディオ生成に革命

米Metaは8月2日(現地時間)、テキストプロンプトから音楽や音声を生成する生成AIツールスイート「AudioCraft」をオープンソース化したと発表しました。トレーニングに使うデータの多様化もオープンソース化のねらいの1つだ。MetaはAudiocraftを通じて、研究目的向けの音楽およびオーディオ生成に利用できる3つのAIツールをリリースします。この記事では、Audiocraftとそのモデルの機能について詳細に解説します。

Audiocraftの機能

Audiocraftは、以下の3つのAIモデルから構成されています。

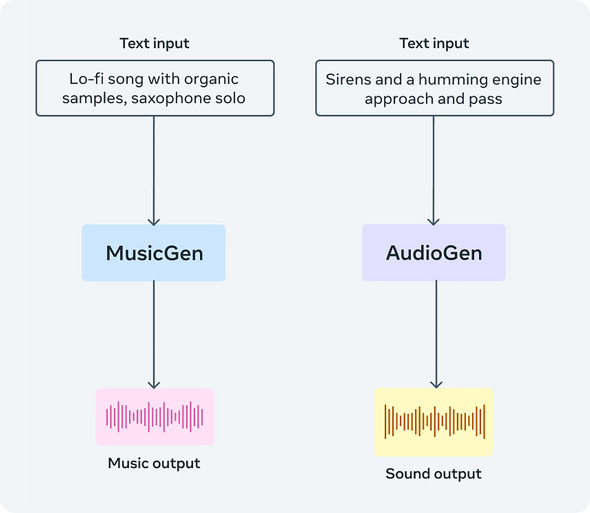

1. MusicGen(テキストからメロディーを生成する)

Audiocraftの中核をなすAIモデルであるMusicGenは、テキストやその他の音楽情報からメロディーや楽曲を生成できるものです。2023年6月に導入されたこのモデルは、高度な音楽生成技術を採用しており、革新的な音楽制作プロセスを実現します。また、MusicGenは単体で6月にオープンソース化されている。

2. AudioGen(エフェクトやサウンドスケープを生成する)

AudioGenは、2022年10月にリリースされたTransformerベースの生成AIモデルです。このモデルを使用することで、テキスト入力に応じてサウンドを生成したり、既存のオーディオファイルを拡張したりすることができます。音楽家やサウンドデザイナーにとって、アイデアのインスピレーションや既存作品の改善をスムーズに行う手段となります。

3. EnCodec(ニューラルネットワークベースのオーディオ圧縮コーデック)

MetaのオーディオトークナイザーEnCodecは、AI処理のためにオーディオファイルを小さな部分に分割する役割を果たします。拡張バージョンも利用可能で、高品質な音楽生成にアーティファクトを最小限に抑えることが可能です。

Audiocraftの可能性と利用方法

Metaは、「ひとたびモデルにアクセスしてニーズに合わせて調整できるようになれば、可能性はほぼ無限に広がります」と述べています。Audiocraftを使用することで、ミュージシャンやサウンドデザイナーは、新たな創造的な可能性を手に入れることができます。また、インディーズ開発者は限られた予算で信じられないほど多様なサウンドエフェクトを作成する支援を受けることができます。

メタ研究チームは、生成オーディオ、特に拡散モデルに基づく高品質オーディオの研究を続けています。

これは、画像生成の大幅な品質向上につながったのと同じ技術です。

オープンソースへのコミットメント

Metaは、Audiocraftファミリーのモデルをオープンソース化し、誰もが平等にアクセスできるようにすることに強いコミットメントを持っています。このような責任あるイノベーションが、AIオーディオ生成の未来により多くの可能性をもたらすことでしょう。

まとめ

Audiocraftは、音楽とオーディオ生成用の革新的な3つのAIツールを提供するMetaの無料モデルキットです。MusicGen、AudioGen、EnCodecの3つのモデルが、研究者に高品質なオーディオ生成の手段を提供し、ミュージシャンやサウンドデザイナーに新たな創造的な可能性をもたらします。このテクノロジーの進化に期待し、より多くのアーティストが音楽の表現力を拡大できる未来が待ち望まれます。

Audiocraft のコードはここから入手できます

※AudioCraftのインストールには、少なくとも16GBのメモリを備えるGPU、Python 3.9、PyTorch 2.0.0が必要です。

FAQs

- Audiocraftは商用利用を許可していますか?

現時点では、Audiocraftは商用利用を許可していません。ただし、今後のアップデートに期待しましょう。 - Audiocraftのモデルをカスタマイズできますか?

はい、Audiocraftのモデルはカスタマイズ可能です。ユーザーのニーズに合わせて調整できます。 - Audiocraftの生成した音楽は著作権に対応していますか?

生成された音楽の著作権は、作成者や利用規約によって異なります。必ず著作権に関する情報を確認しましょう。 - Audiocraftの利用には特別なハードウェアが必要ですか?

一部の機能を使用する際には、高性能なハードウェアが必要な場合があります。公式サイトでシステム要件を確認しましょう。 - Audiocraftの学習曲線はどのくらいですか?

Audiocraftの学習曲線は、データセットの大きさやモデルの複雑性によって異なります。詳細な情報は公式ドキュメントを参照してください。