OpenAI の DALL-E 3 は、画像の詳細と精度の向上の基準を引き上げる可能性があります

MattVidPro AIは5月に初めてDiscordチャンネルで名乗り出て、OpenAIの新しいAI画像モデルのアルファテストに参加していると主張した人物です。彼は、特にフォントの生成とプロンプトの照合において、DALL-E 3 の大幅な進歩を示す例を公開しています。

OpenAI DALL-E 3

OpenAI の DALL-E 3 は、最新の画像モデルであり、精度と詳細において大きな進歩を遂げています。YouTuber MattVidPro AI による情報によれば、DALL-E 3 は、フォントの生成やプロンプトの照合などで驚くべき能力を持っているとされています。

リーカーによる DALL-E 3 の情報

– DALL-E 3 の「クローズド アルファ」テスト バージョン

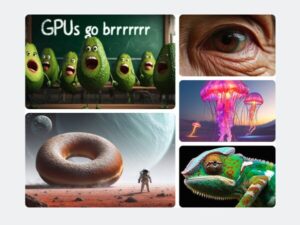

7月中旬、リーカーは再び現れ、DALL-E 3 の「クローズド アルファ」テスト バージョンを使用して生成したと主張するさらに多くの例を示しました。彼によれば、このテストバージョンは無修正であるため、暴力やヌードのシーン、または著作権で保護された素材が含まれている可能性があります。

– DALL-E 3 のテストバージョンに関する注意点

画像では右下隅に典型的な DALL-E マークが示されていますが、これは簡単に偽造できる可能性があります。リーカーの情報によれば、新世代のモデルは、ディテールやフォントの点で、現在のモデルの機能を上回っています。

DALL-E 3 の精度と評価

– Google Parti との比較

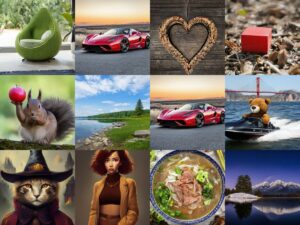

テスターによると、DALL-E 3 の結果はGoogle Partiよりも「大幅に」優れており、さらに1年前にGoogleが発表したDALL-E 2をも上回っているとされています。リーカーは、党の文書からのプロンプトをテストしましたが、DALL-E 3 の優位性が明確に示されました。

– 画像モデルの言語理解の向上

DALL-E 3 のデモンストレーションでは、新しいモデルが言語をよりよく理解していることが示されています。例えば、「afriad」と書かれているプロンプトでも、モデルは「afraid」と正確に修正しています。

DALL-E 2 は 1 年以上前から作られており、Midjourney や Stable Diffusion に追い抜かれるまではクラス最高でした。しかし、マット氏は、OpenAI は DALL-E への取り組みを止めておらず、市場の他のモデルよりも優れた画像合成モデルを発表しようとしているのかもしれないと主張しています。

DALL-E 3 の重要性と影響

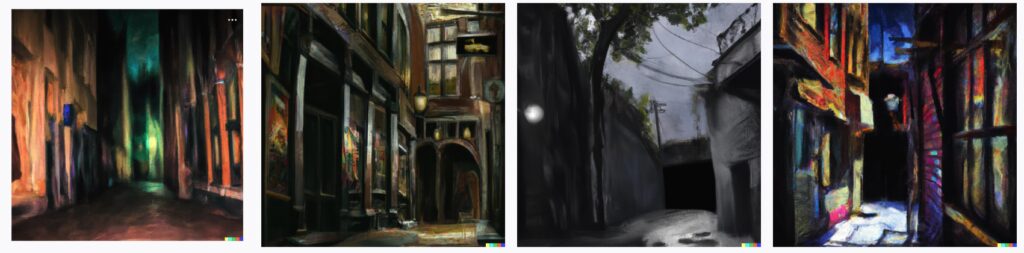

プロンプト|A group of farm animals (cows, sheep, and pigs) made out of cheese and ham, on a wooden board. There is a dog in the background eyeing the board hungrily.

– チーズと動物のシーン

DALL-E 3 の重要な特徴は、チーズと動物のシーンを正確にレンダリングできることです。これにより、潜在的な DALL-E 3 モデルは、さまざまなコンテンツの概念を明確に分離し、より複雑な画像構成を可能にしています。

– 潜在的な DALL-E 3 モデルの優位性

DALL-E 3 の進化は、画像モデルの分野全体に大きな影響を与える可能性があります。既存のモデルよりも優れた精度と詳細性により、画像生成技術は飛躍的に向上する見込みです。

– 次世代画像 AI の進化

DALL-E 3 の登場は、OpenAI を含む多くの企業が次世代の画像 AI を開発していることを示しています。他社も新しいアーキテクチャを導入し、高精度で効率的な画像とフォントの生成を実現しています。

OpenAIなどが次世代の画像AIを開発しました。最初に登場したDALL-E 2は、発売後すぐにMidjourneyとStable Diffusionに追い抜かれ、その後、ChatGPTとGPT-4による誇大宣伝の中で埋もれてしまいました。ただし、OpenAIは画像AIシステムの開発を継続しています。

最初の兆候として、MicrosoftがBing Image Creatorを導入しました。Bing Image CreatorはDALL-E 2の「より良いバージョン」を使用しているとされていますが、具体的な詳細は不明です。Image Creatorの結果は、MidjourneyやDALL-E 2.5と同様に安定したディフュージョンXLの特性を持っているようです。

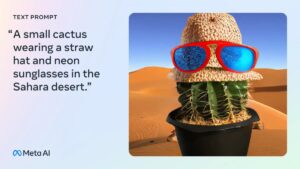

DALL-E 2の登場以来、画像モデルの分野では多くの進展があり、Metaなどの企業は、画像やフォントの生成を効率的かつ高精度に行う新しいアーキテクチャを導入しています。

特に、Metaの最新の画像モデルであるCM3leonは、選択した例に基づくと、DALL-E 3世代のような高い詳細を持ち、プロンプトに合致するようです。また、CM3leonはライセンスされた素材のみを使用してトレーニングされています。

今年の初めに、Googleは高速AI画像モデルであるMuseを発表し、以前のモデルよりも正確にプロンプトに従い、テキストを生成できることを示しました。

4月には、OpenAI研究チームがDALL-E 2よりもはるかに高速に生成する「一貫性モデル」と呼ばれる新しいアーキテクチャを発表しました。このアーキテクチャは高品質を維持しつつ、ビデオ生成の先駆けとなる可能性があります。

AI画像モデルは大幅に進化していますが、まだ製品化されていません。しかし、DALL-E 3の登場によって、この状況が変わる可能性もあります。

DALL-E 3 の製品化に向けて

AI 画像モデルは大幅に進歩しましたが、まだ製品化されていません。しかし、DALL-E 3 の登場により、これまで以上に製品化に近づいている可能性があります。OpenAI の DALL-E 3 は、画像の詳細と精度の向上において重要な進化を遂げています。リーカーによる情報によれば、DALL-E 3 は非常に優れた能力を持っており、次世代の画像 AI 技術の発展に貢献することが期待されます。

よくある質問(FAQ)

- Q: DALL-E 3 はどのような特徴を持っていますか?

- A: DALL-E 3 はフォントの生成やプロンプトの照合において大きな進歩を遂げており、精度と詳細に優れた能力を持っています。

- Q: DALL-E 3 は DALL-E 2 とどのように異なりますか?

- A: テスターによると、DALL-E 3 はDALL-E 2 よりも優れた結果を示しており、特にGoogle Partiよりも大幅に優れています。

- Q: DALL-E 3 は製品化される予定はありますか?

- A: 現時点ではDALL-E 3 は製品化されていませんが、その重要な進化により製品化の可能性が高まっています。

- Q: DALL-E 3 はどのような分野に影響を与える可能性がありますか?

- A: DALL-E 3 の進化は、画像モデルの分野全体に大きな影響を与え、次世代の画像 AI 技術の進化を促進することが期待されます。

- Q: どのような企業が次世代の画像 AI を開発していますか?

- A: OpenAI の他にも、Microsoft や Meta などの企業も次世代の画像 AI 技術の開発に取り組んでいます。